Jak ocalić kruche dziedzictwo: Nowoczesne technologie w służbie historycznych księgozbiorów |

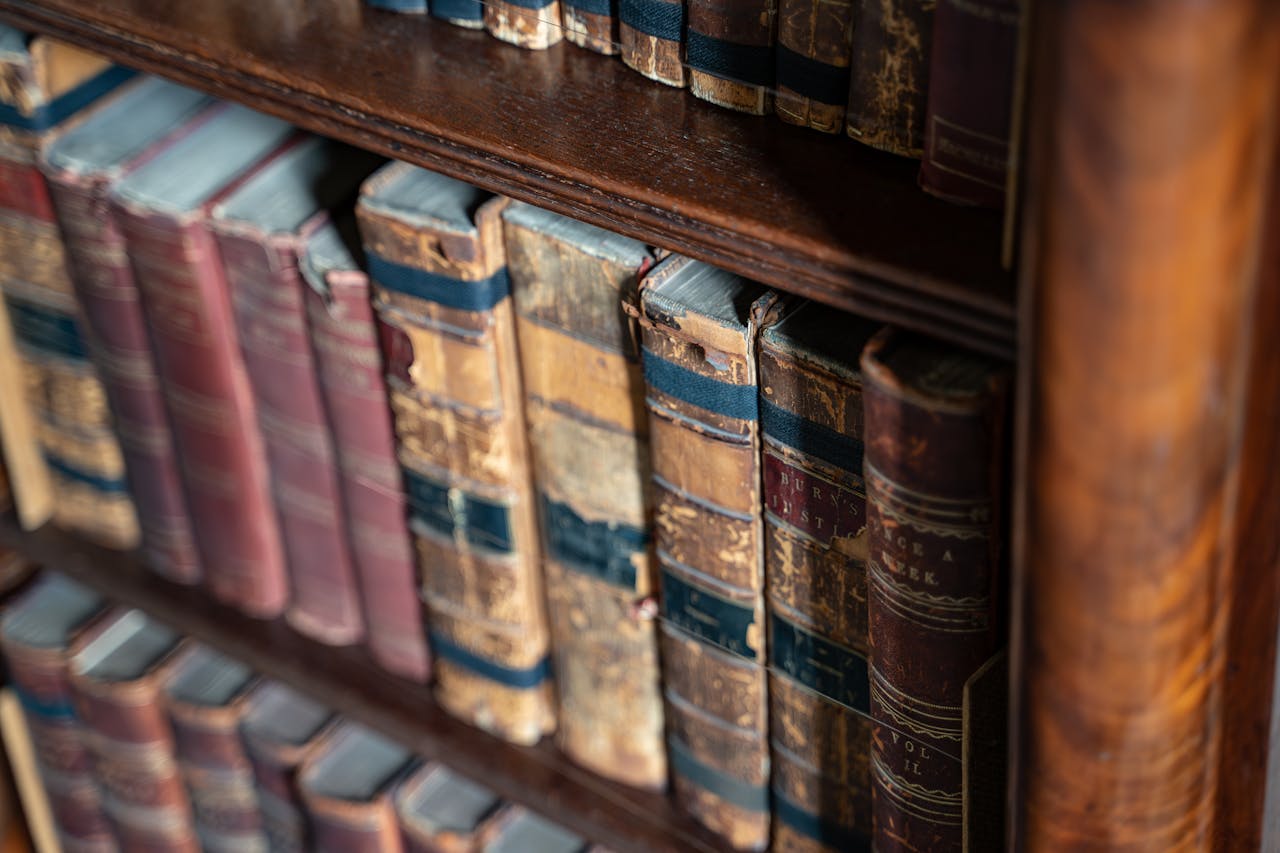

Dla każdego miłośnika historii, badacza dawnych dziejów czy genealoga, fizyczny kontakt z wielowiekowym dokumentem to niepowtarzalne przeżycie. Niestety, ten sam bezpośredni kontakt stanowi największe zagrożenie dla historycznej materii - każdy dotyk, każda najmniejsza dawka światła oraz zmiana wilgotności nieuchronnie przybliżają kruchy papier i pergamin do rozpadu. Przed światem nauki i instytucjami dziedzictwa narodowego stanęło zatem gigantyczne wyzwanie: jak udostępniać najcenniejsze zapiski ludzkości szerokiej publiczności, jednocześnie chroniąc je przed zniszczeniem?

Paradoks archiwistyki w cyfrowej erze

Współczesna dygitalizacja zbiorów bibliotecznych, archiwalnych i muzealnych stanowi jeden z najbardziej fascynujących obszarów, w którym nauki humanistyczne spotykają się z zaawansowaną inżynierią i chemią konserwatorską. Ewoluowała ona z prostej chęci posiadania kopii zapasowej w stronę kompleksowej strategii ochrony.

Kustosze i archiwiści od zawsze borykali się z narastającym paradoksem. Z jednej strony ich misją jest demokratyzacja wiedzy i umożliwienie dostępu do tekstów źródłowych jak najszerszej grupie odbiorców. Z drugiej - spoczywa na nich bezwzględny obowiązek fizycznego zabezpieczenia woluminów przed nieuchronną degradacją, która wynika bezpośrednio z ekspozycji i użytkowania.

Współczesne, realizowane zgodnie z rygorystycznymi normami konserwatorskimi skanowanie książek pozwala na wykreowanie tak zwanego „cyfrowego surogatu”. W wielu aspektach badawczych ten wirtualny odpowiednik nie tylko skutecznie zastępuje oryginał, ale wręcz go przewyższa, ujawniając informacje od wieków ukryte przed ludzkim okiem.

Architektura delikatności, czyli inżynieria nieinwazyjnego skanowania

Największym wrogiem starych ksiąg jest ich otwieranie. Historyczne oprawy, wyschnięte przez stulecia kleje introligatorskie, lniane nici oraz sztywność samego pergaminu sprawiają, że próba otwarcia starodruku pod standardowym kątem 180 stopni zazwyczaj kończy się tragicznie - pęknięciem grzbietu, naruszeniem szycia lub wręcz wypadnięciem bezcennych kart.

Fundamentem bezpieczeństwa jest tu odpowiednio zaprojektowany sprzęt. Profesjonalny skaner do książek, przeznaczony do pracy ze zbiorami zabytkowymi, całkowicie rezygnuje z konstrukcji płaskich (znanych z domowych urządzeń) na rzecz zaawansowanych systemów planetarnych oraz bezkontaktowych. Zamiast zmuszać księgę do leżenia na płasko, wykorzystuje się specjalistyczne kołyski w kształcie litery V. Ich konstrukcja pozwala na bezpieczne ułożenie woluminu przy kącie rozwarcia wynoszącym, w zależności od stanu zachowania obiektu, od 60 do 120 stopni.

Szczytowym osiągnięciem w dziedzinie automatyzacji ochrony grzbietu są obecnie systemy wykorzystujące technologię pryzmatyczną. Pozwalają one na przechwytywanie obrazu wysokiej rozdzielczości przy zaledwie 60-stopniowym rozwarciu. Co więcej, aby zminimalizować ryzyko fizycznego uszkodzenia krawędzi kart przez ludzkie ręce, maszyny te potrafią obracać strony całkowicie bezdotykowo, za pomocą precyzyjnie regulowanego strumienia powietrza. Z kolei przy dygitalizacji wielkoformatowych map czy gazet historycznych, wykorzystuje się zautomatyzowane ramiona robotyczne (np. w systemach SMA), które z niezwykłą czułością naśladują ludzki ruch, operując bez problemu na formatach sięgających A0+.

Równie ważnym aspektem jest inżynieria światła. Historyczne pigmenty, inkausty galusowe oraz barwniki są ekstremalnie wrażliwe na promieniowanie ultrafioletowe (UV) i podczerwone (IR), które niczym katalizator przyspieszają rozpad włókien celulozy i białek kolagenowych. Nowoczesne urządzenia wykorzystują bezcieniowe oświetlenie LED, tzw. „zimne światło”, z którego całkowicie wycięto szkodliwe pasma. Dzięki temu temperatura na powierzchni bezcennego inkunabułu nie wzrasta nawet o ułamek stopnia, zapobiegając przesuszaniu i pofalowaniu materiału.

Zobaczyć niewidzialne: Obrazowanie multispektralne (MSI)

Dla historyków i badaczy tekstów źródłowych dygitalizacja XXI wieku oferuje narzędzia pozwalające dosłownie „widzieć przez czas”. Obrazowanie multispektralne (MSI) to technologia, która wykracza poza zakres światła widzialnego, stając się nieodzownym elementem zabezpieczania zbiorów.

Zamiast wykonywać zwykłe zdjęcie w świetle białym, systemy multispektralne rejestrują obraz w kilkunastu niezwykle wąskich pasmach fali elektromagnetycznej. Zaawansowane matryce naświetlają obiekt od bliskiego ultrafioletu, poprzez całe spektrum widzialne, aż po głęboką podczerwień. Oddziaływanie poszczególnych fal z historyczną materią przynosi fascynujące rezultaty:

Ultrafiolet (UV): Wywołuje fluorescencję określonych substancji. W tym świetle widoczne stają się dawne, zatarte naprawy introligatorskie, ogniska infekcji grzybiczych oraz chemiczne retusze, które dla nieuzbrojonego oka pozostają całkowicie niewidoczne.

Podczerwień (IR): Posiada niezwykłą właściwość przenikania przez wierzchnie warstwy brudu, kurzu, a nawet przez niektóre nowsze pigmenty. To właśnie IR pozwala naukowcom na odczytywanie palimpsestów (pergaminów, z których w starożytności zeskrobano pierwotny tekst, by zapisać nowy), a także szkiców wykonanych pod warstwą farby na historycznych mapach.

Dzięki algorytmom analizy spektralnej system operacyjny potrafi z ogromną precyzją wyodrębnić „czyste pigmenty”. Dla badacza oznacza to możliwość cyfrowego odseparowania właściwego tekstu od późniejszych plam z wilgoci, pieczęci czy zjawiska przebijania agresywnego atramentu z drugiej strony karty.

Mapowanie 3D: Korekcja bez dotyku

Starodruki niemal nigdy nie są idealnie płaskie. Upływ czasu, higroskopijność pergaminu i warunki przechowywania sprawiają, że ich strony falują, a w okolicach grzbietu tworzą się głębokie, ciemne załamania. Tradycyjne skanowanie w dwóch wymiarach nieuchronnie skutkuje zniekształceniami liter i nieczytelnością tekstu przy łączeniach.

Współczesna odpowiedź na ten problem polega na integracji obrazu multispektralnego z mapowaniem 3D przy użyciu światła strukturalnego. Specjalny projektor rzuca na stronę księgi gęstą siatkę świetlnych wzorców, a kamera rejestruje najdrobniejsze zakrzywienia tych linii na nierównym papierze. Powstaje w ten sposób niezwykle precyzyjna, trójwymiarowa mapa wysokości dokumentu. Na jej podstawie oprogramowanie poddaje obraz procesowi cyfrowego spłaszczania (Digital Flattening). Algorytm matematycznie „rozprostowuje” kartę na płasko, eliminując zniekształcenia perspektywy i cienie, nie wywierając przy tym najmniejszego nacisku na fizyczny obiekt.

Od obrazu do bazy wiedzy: Przełom w rozpoznawaniu tekstu historycznego

Skuteczna dygitalizacja to taka, która ze zwykłego pliku graficznego czyni użyteczne źródło danych. Największym przełomem ostatniej dekady jest ewolucja od klasycznego OCR (Optical Character Recognition), które radzi sobie z nowoczesnym drukiem, do systemów ATR (Automated Text Recognition), zasilanych potężnymi modelami sztucznych sieci neuronowych.

Dawne księgi stawiają przed oprogramowaniem ogromne bariery. Przed erą przemysłową każda manufaktura drukarska stosowała unikalne, ręcznie odlewane czcionki. Na stronach królują skomplikowane fraktury, szwabachy, pisma gotyckie, zawiłe ligatury oraz całkowity brak skodyfikowanych norm ortograficznych. Dawna polszczyzna potrafi być zapisana na dziesiątki różnych sposobów.

Dziś platformy takie jak Transkribus, wykorzystujące modele HTR (Handwritten Text Recognition) oparte na sieciach neuronowych (LSTM i architekturze Transformer), pozwalają na odczytanie tych zapisków z niesamowitą skutecznością. Systemy te są trenowane na ogromnych pakietach danych i potrafią analizować kontekst całych zdań. Modele potrafią z dużą precyzją odczytywać zarówno dawne druki, jak i wielowiekowe pismo odręczne. Dzięki uczeniu maszynowemu i korektom (fine-tuning) badacze osiągają dziś poziom błędu w rozpoznawaniu znaków spadający poniżej 1,5%, co stawia maszyny na równi z doświadczonymi paleografami. Dzięki temu, historyczne kroniki z XVI wieku stają się równie łatwe do przeszukiwania jak współczesne strony internetowe.

Standardy przetrwania w cyfrowym świecie

Samo wygenerowanie doskonałego cyfrowego obrazu i odczytanie jego tekstu to dopiero połowa sukcesu. Pliki cyfrowe są wysoce nietrwałe - grozi im tzw. „bit rot” (degradacja danych) oraz gwałtowne starzenie się formatów. Aby zapewnić, że cyfrowe zbiory będą dostępne dla badaczy za 50 czy 100 lat, instytucje stosują rygorystyczne procedury ochrony oparte na skomplikowanych metadanych.

Kluczowe są tu trzy filary infrastruktury informatycznej: standard METS, który działa jak wirtualna oprawa łącząca pliki graficzne i informacje o książce; standard ALTO, zapamiętujący fizyczną koordynatę każdego słowa na zeskanowanej stronie; oraz PREMIS, pełniący funkcję cyfrowej „czarnej skrzynki”, rejestrującej każdą operację wykonaną na pliku od momentu jego powstania. Jak wskazują materiały analityczne i studia przypadków publikowane przez firmę Skanowanie.pl, wdrożenie standardu PREMIS i przemyślanych architektur metadanych jest absolutnie niezbędne, aby biblioteki cyfrowe mogły automatycznie audytować swoje zbiory i bezstratnie migrować je do nowych formatów w przyszłości.

Aby ta cyfrowa wiedza nie pozostawała uwięziona na lokalnych serwerach bibliotek, wdrożono standard IIIF (International Image Interoperability Framework). Dzięki otwartym interfejsom API badacz może dziś bez pobierania gigabajtowych plików płynnie powiększać mikroskopijne detale starych map (tzw. Deep Zoom) oraz wirtualnie, w jednym oknie przeglądarki, zestawiać obok siebie i porównywać księgi, z których jedna fizycznie spoczywa w sejfie w Warszawie, a druga w archiwach watykańskich. Świetnym przykładem wykorzystania tego formatu jest polska platforma Polona oraz sieć Europeana, które udostępniają miliony obiektów wspierając dyskurs naukowy i nowatorską edukację.

Przyszłość: Wirtualna konserwacja i sztuczna inteligencja

Dziedzina ochrony dziedzictwa nie zwalnia tempa. Obecnie najśmielsze projekty badawcze skłaniają się ku generatywnej sztucznej inteligencji. Modele dyfuzyjne oraz sieci typu GAN są dziś uczone stylistyki historycznych artystów po to, by precyzyjnie sugerować naukowcom, jak mogły wyglądać zatarte słowa czy brakujące fragmenty uszkodzonych rycin.

Równie fascynująca jest koncepcja „cyfrowych bliźniaków” (Digital Twins). To zaawansowane modele 3D, które reagują w środowisku wirtualnym na symulowane zmiany wilgotności i oświetlenia. Pozwala to konserwatorom sprawdzić cyfrowo, w jakich warunkach starodruk zacznie niszczeć, bez konieczności poddawania eksperymentom fizycznego bezcennego białego kruka.

Podsumowanie

Nowoczesna dygitalizacja dawno przestała być wyłącznie zagadnieniem technicznym polegającym na kopiowaniu obrazu. Stała się pełnoprawną formą bezinwazyjnej konserwacji. Integracja wyspecjalizowanej, delikatnej aparatury, analizy światła w paśmie niewidzialnym oraz uczenia maszynowego służy dziś podwójnemu celowi.

Z jednej strony definitywnie chroni oryginalny nośnik przed degradacją, wycofując go z codziennego, fizycznego obiegu. Z drugiej strony rewolucjonizuje samą humanistykę - cyfrowe, nasycone bogatymi metadanymi surogaty stają się globalnym dobrem publicznym. Ratowanie historycznych księgozbiorów przed upływem czasu nigdy wcześniej nie dawało nam tak głębokiego wglądu w tajemnice naszych przodków.

Artykuł powstał w płatnej współpracy z skanowanie.pl.

Lubisz czytać nasze historie?

Na historia.org.pl codziennie opowiadamy dzieje Polski i świata tak, jak na to zasługują - rzetelnie, pasjonująco, z szacunkiem do faktów. Ale żadna opowieść nie przetrwa bez tych, którzy chcą jej słuchać i ją wspierać.

Postaw nam wirtualną kawę - to darowizna, która realnie pomaga nam działać dalej. To dzięki takim gestom możemy nadal pisać o zwycięstwach, bohaterach i wydarzeniach, które zbudowały naszą tożsamość.